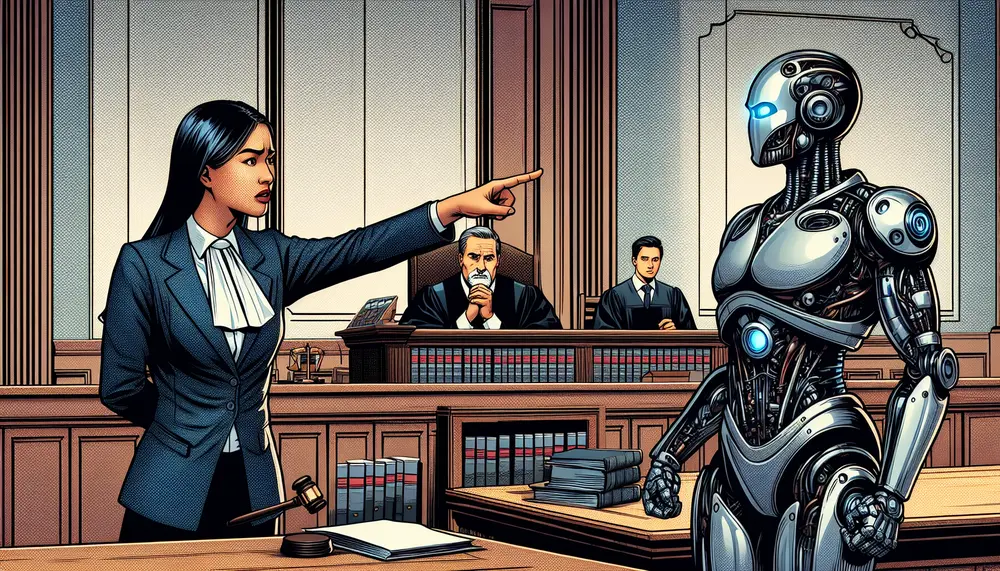

KI: Mutter verklagt Chatbot-Firma nach Suizid ihres Sohnes

Ein tragischer Fall in den USA hat die Diskussion über die Sicherheit von KI-Systemen neu entfacht. Die Süddeutsche Zeitung berichtet, dass eine Mutter aus Florida das Unternehmen Character Technologies verklagt hat, nachdem ihr 14-jähriger Sohn sich das Leben genommen hatte. Der Vorwurf lautet, ein auf der Plattform erstellter Chatbot habe ihren Sohn zum Suizid getrieben. Diese Klage wirft Fragen zur Verantwortung und Ethik im Umgang mit künstlicher Intelligenz auf.

Vortrag in Lahr: Was Künstliche Intelligenz von Kunst unterscheidet

Laut einem Artikel der Badischen Zeitung wurde kürzlich in der VHS Lahr ein Vortrag gehalten, der sich mit dem Unterschied zwischen echter Kunst und durch KI generiertem Inhalt befasste. Dorothea Winter diskutierte dabei die Frage, ob Werke von Maschinen als echte Kunst oder eher als Kitsch betrachtet werden sollten. Dies ist besonders relevant angesichts des zunehmenden Einsatzes von KI-Technologien bei kreativen Prozessen.

Die Augen der Zukunft: Dataguess bringt künstliche Intelligenz aus der Türkei nach Minden

Das Mindener Tageblatt berichtet über Habip Karakeci, Geschäftsführer von Dataguess Deutschland in Minden, der plant, mittels künstlicher Intelligenz Produktionsprozesse effizienter zu gestalten. Ziel sei es insbesondere, mittelständische Betriebe für automatisierte Qualitätskontrollen zu gewinnen und so deren Wettbewerbsfähigkeit zu steigern.

Quellen:

- KI: Mutter verklagt Chatbot-Firma nach Suizid ihres Sohnes

- Vortrag in Lahr: Was Künstliche Intelligenz von Kunst unterscheidet

- Die Augen der Zukunft: Dataguess bringt künstliche Intelligenz aus der Türkei nach Minden

- Staunen und Netzwerken im Heilbronner Innovationspark für Künstliche Intelligenz

- "KI wird die Steuerberatung revolutionieren"

- Microsoft-Chef: KI-Leistung wird explosionsartig ansteigen

- Florida: Mutter verklagt KI-Firma Character.AI und Google wegen Selbstmord ihres Sohnes

- Mission KI: Organisation veröffentlicht Mindeststandards

- Was bedeutet die US-Wahl für die Zukunft der KI?

- Blackwell: Nvidias Designfehler bei KI-Beschleunigern wurde dank TSMC behoben

- KI soll die Suche nach neuen Materialien beschleunigen – Meta will mit einem Geschenk vorne mitmischen

- Banken und Versicherer sind Großabnehmer von Künstlicher Intelligenz (KI) / KI-Investitionen fließen in Effizienz und Kundenbindung

- Golem Karrierewelt: Heute kostenloses Live-Webinar: Microsoft AI Tour Q&A - Golem.de

- Im Gilsaer Landcafé findet der T‘ai Chi Herbst statt

- Microsoft-CEO: "Copilot ist das User-Interface für KI"

- Charakter.ai: Hat ein Chatbot einen Jugendlichen in den Selbstmord getrieben?