Inhaltsverzeichnis:

Historische Entwicklung und technologische Meilensteine der KI

Die Geschichte der künstlichen Intelligenz beginnt nicht mit ChatGPT oder dem ImageNet-Durchbruch 2012 – sie reicht bis in die Mitte des 20. Jahrhunderts zurück. Alan Turings wegweisender Aufsatz "Computing Machinery and Intelligence" aus dem Jahr 1950 formulierte erstmals die Frage, ob Maschinen denken können, und etablierte mit dem Turing-Test ein Konzept, das bis heute die KI-Diskussion prägt. Wer verfolgt, wie sich KI über Jahrzehnte gewandelt hat, erkennt schnell: Die Technologie durchlief mehrere fundamentale Paradigmenwechsel, keine lineare Progression.

Von symbolischer KI zu neuronalen Netzen

Die erste KI-Ära, grob von 1956 bis in die 1980er Jahre, dominierte die symbolische KI – regelbasierte Systeme, die menschliches Wissen explizit kodieren. Expertensysteme wie MYCIN (1976) für medizinische Diagnosen oder XCON (1980) für die Konfiguration von DEC-Minicomputern erzielten in engen Domänen beachtliche Ergebnisse. XCON sparte Digital Equipment Corporation nachweislich 40 Millionen Dollar jährlich ein. Doch die Grenzen zeigten sich rasch: Jede neue Regel erzeugte Widersprüche, die manuelle Pflege war nicht skalierbar, und das sogenannte Brittle-Problem – das Versagen außerhalb eng definierter Parameter – machte Expertensysteme für reale Komplexität unbrauchbar.

Der erste KI-Winter (1974–1980) und der zweite (1987–1993) entstanden nicht durch technisches Versagen allein, sondern durch überzogene Erwartungen gepaart mit realen Leistungsgrenzen. Fördergelder versiegten, Projekte wurden eingestellt. Ausgerechnet in dieser Phase legten Geoffrey Hinton, Yann LeCun und Yoshua Bengio die theoretischen Grundlagen für das Backpropagation-Verfahren, das neuronale Netze trainierbar machte – damals weitgehend ignoriert, heute als Fundament moderner KI anerkannt.

Der Deep-Learning-Durchbruch und seine Konsequenzen

2012 markiert einen echten Wendepunkt: AlexNet gewann den ImageNet-Wettbewerb mit einer Top-5-Fehlerrate von 15,3 Prozent – gegenüber 26,2 Prozent des Zweitplatzierten. Möglich wurde das durch drei konvergierende Faktoren: die Verfügbarkeit großer gelabelter Datensätze, günstige GPU-Rechenleistung und verbesserte Trainingstechniken. Eine chronologische Betrachtung dieser Entwicklungsstufen zeigt, wie sich die Abstände zwischen Durchbrüchen seither drastisch verkürzt haben.

Die nachfolgende Dekade brachte Meilensteine in dichter Folge:

- 2016: AlphaGo besiegt Go-Weltmeister Lee Sedol – ein Spiel mit mehr möglichen Positionen als Atome im Universum

- 2017: Das Transformer-Modell ("Attention is All You Need") revolutioniert die Sprachverarbeitung

- 2020: GPT-3 mit 175 Milliarden Parametern demonstriert emergente Fähigkeiten durch reine Skalierung

- 2022: ChatGPT erreicht 100 Millionen Nutzer in zwei Monaten – schneller als jede Technologie zuvor

- 2024: Multimodale Modelle wie GPT-4o und Gemini Ultra verarbeiten Text, Bild und Audio nativ

Was diese Entwicklung für Praktiker bedeutet: KI ist keine monolithische Technologie, sondern ein Ökosystem aus Ansätzen mit spezifischen Stärken und Blindstellen. Die aktuellen Entwicklungsrichtungen zeigen, dass das Feld heute gleichzeitig an Effizienzsteigerung (kleinere, spezialisierte Modelle), Multimodalität und Reasoning-Fähigkeiten arbeitet – drei Richtungen, die unterschiedliche Unternehmensstrategien erfordern.

Technologische Grundlagen: Machine Learning, Deep Learning und neuronale Netze

Machine Learning (ML) ist kein Monolith, sondern ein Oberbegriff für Algorithmen, die aus Daten lernen, ohne explizit programmiert zu werden. Der entscheidende Unterschied zur klassischen Softwareentwicklung: Statt Regeln vorzuschreiben, lernt das System selbst Muster aus Beispieldaten. Dabei unterscheidet man grundlegend zwischen überwachtem Lernen (labeled data, klare Ausgabe), unüberwachtem Lernen (Clustering, Anomalieerkennung) und bestärkendem Lernen (Reward-Signale, wie bei AlphaGo). Wer heute mit KI arbeitet, muss diese drei Paradigmen nicht nur kennen, sondern verstehen, welches für welches Problem geeignet ist.

Neuronale Netze und der Durchbruch des Deep Learning

Neuronale Netze sind mathematische Strukturen, grob inspiriert von biologischen Nervenzellen. Ein klassisches Feedforward-Netz besteht aus Eingabe-, verborgenen und Ausgabeschichten – jede Schicht transformiert Daten durch gewichtete Verbindungen und Aktivierungsfunktionen wie ReLU. Der eigentliche Quantensprung kam mit Deep Learning: Netze mit vielen Schichten (oft hunderte bis tausende) können hierarchische Merkmale extrahieren. Ein Bilderkennungsnetz lernt in frühen Schichten Kanten, dann Formen, dann semantische Konzepte. Diese Abstraktionsfähigkeit war mit flachen Modellen schlicht unerreichbar.

Der Durchbruch von AlexNet 2012 beim ImageNet-Wettbewerb markiert einen Wendepunkt: Die Fehlerrate sank von ~26% auf ~15% – ein Sprung, der die gesamte Branche elektrisierte. Seither skalieren Modelle exponentiell. GPT-3 (2020) hatte 175 Milliarden Parameter, GPT-4 schätzungsweise über eine Billion. Diese Skalierung ist kein Selbstzweck – sie bringt Fähigkeiten hervor, die noch vor wenigen Jahren als jahrzehntelange Forschungsaufgabe galten.

Transformer-Architektur: Das Fundament moderner KI

Seit dem Paper „Attention Is All You Need" (Vaswani et al., 2017) dominiert die Transformer-Architektur die KI-Entwicklung. Der Schlüsselmechanismus ist Self-Attention: Das Modell gewichtet für jedes Token, welche anderen Tokens im Kontext relevant sind – parallel, nicht sequenziell wie bei LSTMs. Das ermöglicht extrem effizientes Training auf GPUs und die Verarbeitung langer Kontextfenster. Anwendungen wie das direkte Befragen von KI-Systemen im Browser basieren genau auf dieser Architektur.

Für Praktiker relevant sind diese Kernkonzepte:

- Embeddings: Wörter, Bilder oder Audiodaten werden als hochdimensionale Vektoren repräsentiert – semantische Ähnlichkeit wird zur geometrischen Nähe

- Fine-Tuning vs. Prompt Engineering: Vortrainierte Modelle lassen sich entweder durch weiteres Training auf spezifische Aufgaben anpassen oder durch gezielte Eingaben steuern

- Transfer Learning: Ein auf Milliarden Texten vortrainiertes Modell überträgt sein Wissen auf Domänen mit wenigen Beispieldaten

- Convolutional Neural Networks (CNNs): Für Bildverarbeitung weiterhin relevant, oft als Hybridarchitektur mit Transformern kombiniert

Ein konkretes Beispiel für architektonische Spezialisierung liefert der Sprachbereich: DeepL setzt auf speziell optimierte neuronale Netze für maschinelle Übersetzung und schlägt dabei generalistischere Ansätze in Qualitätsbewertungen regelmäßig. Das zeigt: Architekturwahl und Trainingsdesign entscheiden über Praxistauglichkeit – nicht nur Parameterzahl.

Industrielle Anwendungsfelder: Medizin, Verwaltung und Robotik

KI hat sich in den letzten fünf Jahren von einem theoretischen Konzept zu einem handfesten Produktionsfaktor entwickelt – besonders in drei Sektoren, die unterschiedlicher kaum sein könnten, aber eines gemeinsam haben: hohe Datenvolumen, komplexe Entscheidungsprozesse und einen enormen Druck zur Effizienzsteigerung. Wer verstehen will, wo KI heute tatsächlich Wert schöpft und nicht nur Folien auf Konferenzen füllt, muss diese drei Felder im Detail kennen.

Medizin: Diagnostik, Wirkstoffforschung und klinische Entscheidungsunterstützung

Die Medizin ist das vielleicht dynamischste Anwendungsfeld überhaupt. Convolutional Neural Networks erkennen Lungenkarzinome in CT-Scans mit einer Sensitivität von über 94 % – vergleichbar mit erfahrenen Radiologen, aber ohne Ermüdungseffekte nach der zwölften Stunde Dienst. DeepMinds AlphaFold hat die Proteinfaltungsvorhersage revolutioniert und damit Jahrzehnte biochemischer Grundlagenforschung komprimiert: Über 200 Millionen Proteinstrukturen wurden bereits katalogisiert. Für die diagnostischen und therapeutischen Möglichkeiten, die sich dadurch eröffnen, fehlen noch regulatorische Rahmenbedingungen, die mit dem technischen Fortschritt Schritt halten.

Praktisch relevant ist außerdem die prädiktive Analytik in der Intensivmedizin: Systeme wie COMPOSER an der UC San Diego erkennen Sepsis-Risiken bis zu sieben Stunden vor dem klinischen Auftreten. Das gibt Behandlungsteams ein konkretes Zeitfenster. Der entscheidende Engpass bleibt die Integration in bestehende Krankenhaus-IT-Infrastrukturen, die oft aus den 1990ern stammt.

Öffentliche Verwaltung: Automatisierung jenseits des Hype-Zyklus

Behörden verarbeiten täglich Millionen strukturierter Vorgänge – Anträge, Bescheide, Prüfprozesse. Genau hier entfaltet Robotic Process Automation (RPA) kombiniert mit Natural Language Processing seinen stärksten Hebel. Das Bundesamt für Migration und Flüchtlinge hat durch KI-gestützte Dokumentenprüfung Bearbeitungszeiten nachweislich reduziert. Die Stadt Hamburg automatisiert Teile der Gewerbesteuerbearbeitung. Dennoch: Die Potenziale der KI im öffentlichen Sektor stoßen auf spezifische rechtliche und ethische Grenzen, die vor allem den Datenschutz nach DSGVO und das Gebot der Nachvollziehbarkeit behördlicher Entscheidungen betreffen.

Wer KI in Verwaltungsstrukturen einführen will, sollte mit Low-Risk-Prozessen beginnen: standardisierte Formularbewertungen, interne Dokumentenklassifizierung, Chatbots für FAQ-Anfragen. Der Fehler vieler Digitalisierungsprojekte liegt darin, zuerst die komplexesten Verfahren automatisieren zu wollen.

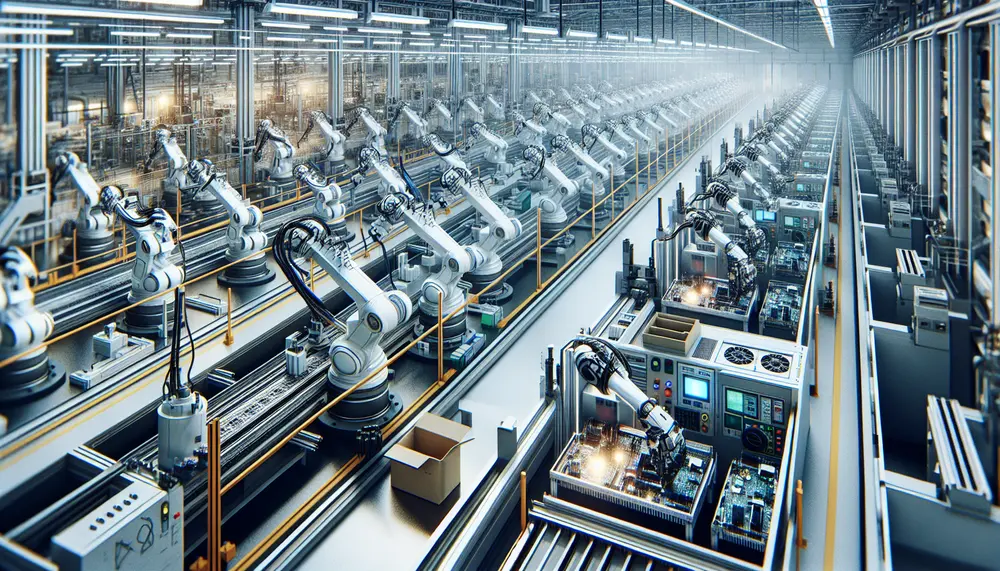

Robotik: Wenn KI einen physischen Körper bekommt

Die Kombination aus maschinellem Lernen und physischen Aktoren verändert Produktionslogik fundamental. Reinforcement Learning ermöglicht es Roboterarmen, Greifaufgaben für unbekannte Objekte ohne explizite Programmierung zu erlernen – Google Robotics demonstrierte 2023, dass ein Roboter nach wenigen Stunden autonomen Trainings über 700 verschiedene Haushaltsgegenstände greifen konnte. In der Automobilindustrie übernehmen kollaborative Roboter (Cobots) Schweißprozesse mit einer Toleranz unter 0,1 Millimeter. Wie tief KI und Robotik bereits miteinander verwachsen sind und welche Architekturen dabei dominieren, ist für Ingenieure und Automatisierungsplaner gleichermaßen relevant.

- Logistikrobotik: Amazon setzt über 750.000 Roboter ein, die durch KI-gesteuerte Wegplanung Lagerprozesse in Echtzeit optimieren

- Chirurgieroboter: Das da Vinci-System hat über 10 Millionen Eingriffe assistiert – mit messbarer Reduktion von Komplikationsraten

- Autonome Inspektionssysteme: Drohnen mit Computer-Vision ersetzen manuelle Sichtprüfungen an Windkraftanlagen und Brückenbauwerken

Übergreifend gilt: Die drei Sektoren unterscheiden sich stark in Regulierungsdichte und Fehlertoleranz. Medizin und Verwaltung verlangen erklärbare, auditierbare Modelle – Black-Box-Ansätze sind dort strukturell ungeeignet. In der Robotik dominiert dagegen die Performanz, was Deep-Learning-Architekturen begünstigt, die sich schwerer interpretieren lassen.

Wirtschaftliche Dimension: Kosten, Investitionen und führende Unternehmen

Der globale KI-Markt wird laut Grand View Research bis 2030 ein Volumen von über 1,8 Billionen US-Dollar erreichen – ein Wachstum, das kaum eine andere Technologiekategorie in dieser Geschwindigkeit vorweist. Allein 2023 flossen weltweit rund 91,9 Milliarden Dollar in KI-Startups und -Projekte. Diese Zahlen spiegeln jedoch nur die Investitionsseite wider. Wer KI produktiv einsetzen will, muss zunächst die eigene Kostensituation realistisch einschätzen.

Was KI-Implementierungen tatsächlich kosten

Die Preisspanne bei KI-Projekten ist enorm: Ein einfacher Chatbot auf Basis vortrainierter Modelle lässt sich für 5.000 bis 20.000 Euro umsetzen, während unternehmenskritische KI-Systeme mit individuellen Trainingsdaten schnell in den siebenstelligen Bereich steigen. Hinzu kommen laufende Infrastrukturkosten – insbesondere für GPU-Rechenkapazitäten in der Cloud, die je nach Nutzungsintensität 10.000 bis 500.000 Euro jährlich ausmachen können. Wer einen detaillierten Überblick über die tatsächlichen Ausgaben bei KI-Projekten benötigt, sollte vor allem zwischen Einmalkosten für Entwicklung und den oft unterschätzten Betriebskosten differenzieren.

Besonders trügerisch ist die scheinbare Günstigkeit von API-basierten Lösungen wie GPT-4 oder Claude. Der Preis pro Token klingt marginal – bei skalierenden Anwendungen mit Millionen von Anfragen monatlich summiert sich das jedoch schnell auf substanzielle Beträge. Microsoft, Google und Amazon subventionieren ihre KI-Dienste derzeit strategisch, um Marktanteile zu sichern. Das bedeutet: Die aktuellen Preise sind keine langfristige Kalkulationsgrundlage.

Investitionsmöglichkeiten und Marktstruktur

Das KI-Ökosystem teilt sich in drei Schichten auf: Infrastruktur (NVIDIA, AMD, TSMC), Plattformen und Modelle (OpenAI, Anthropic, Google DeepMind) sowie Applikationsebene (Salesforce, ServiceNow, C3.ai). NVIDIA dominiert den Chipmarkt mit einem Marktanteil von über 80 Prozent bei KI-Trainingshardware – die H100-GPU kostet pro Einheit rund 30.000 Dollar, und Hyperscaler wie Microsoft oder Google kaufen diese in Zehntausender-Stückzahlen ein. Wer verstehen will, welche Unternehmen diese Wertschöpfungskette langfristig prägen werden, findet in einem Überblick über die einflussreichsten Akteure der KI-Branche eine strukturierte Orientierung.

Für Anleger bietet der Sektor erhebliche Chancen, aber auch Bewertungsrisiken. KI-fokussierte Technologiewerte handelten 2024 teilweise mit KGVs jenseits der 100 – gerechtfertigt nur bei anhaltendem Wachstum. Diversifizierung über thematische ETFs reduziert das Einzeltitelrisiko. Wer kapitaleffizient in den Megatrend investieren möchte, sollte die verschiedenen Ansätze für KI-Investments über Aktien und ETFs vergleichen, bevor Kapital allokiert wird.

- Infrastrukturanbieter (NVIDIA, Broadcom) profitieren unabhängig davon, welche KI-Anwendungen sich durchsetzen

- Hyperscaler (Microsoft, Amazon, Google) monetarisieren KI über Cloud-Dienste mit hohen Margen

- Vertikale Applikationen bieten höheres Wachstumspotenzial, aber auch mehr Wettbewerbsrisiko

- Infrastruktur-Enabler wie Energieversorger werden durch den immensen Strombedarf der Rechenzentren indirekt zum KI-Investment

Ein besonders dynamisches Anwendungsfeld ist der Finanzsektor: Algorithmische Handelssysteme nutzen KI für Mustererkennung in Echtzeit-Marktdaten. Das KI-gestützte automatisierte Trading hat sich von einem Nischenthema institutioneller Investoren zu einem breiteren Marktsegment entwickelt, das auch privaten Anlegern zugänglich wird. Die Verbreitung solcher Systeme verändert Marktmikrostruktur und Liquiditätsmuster fundamental – ein Aspekt, den klassische Investmentanalysen noch kaum berücksichtigen.

Chancen und Risiken: Gesellschaftliche Auswirkungen und ethische Grenzen

KI verändert Gesellschaft und Wirtschaft schneller als jede Technologie zuvor – und die Effekte sind alles andere als eindimensional. Das McKinsey Global Institute schätzt, dass KI-Automatisierung bis 2030 zwischen 400 und 800 Millionen Arbeitsplätze weltweit transformieren wird, während gleichzeitig neue Berufsfelder entstehen, die heute noch kaum existieren. Wer die konkreten Stärken und Schwächen dieser Technologie kennt, kann fundierter entscheiden, wo KI sinnvoll eingesetzt werden soll und wo menschliche Expertise unverzichtbar bleibt.

Wirtschaftliche und soziale Verschiebungen

Die Produktivitätspotenziale sind real und messbar: Unternehmen wie Goldman Sachs berichten von bis zu 40 % Effizienzsteigerungen in bestimmten Analysebereichen durch KI-gestützte Prozesse. Gleichzeitig zeigen sich strukturelle Risiken besonders deutlich im Bereich repetitiver Wissensarbeit – Sachbearbeitung, einfache Rechtsrecherche, Standardprogrammierung. Die Gefahr liegt weniger im vollständigen Jobverlust als in einer Polarisierung des Arbeitsmarktes: Hochqualifizierte, die KI als Werkzeug beherrschen, steigern ihren Wert erheblich, während mittlere Qualifikationsniveaus unter Druck geraten.

Besonders kritisch ist die Frage der algorithmischen Diskriminierung. Amazon musste 2018 ein KI-gestütztes Recruiting-Tool einstellen, weil es systematisch Frauen benachteiligte – trainiert auf historischen Bewerberdaten aus einer männlich dominierten Branche. Solche Bias-Probleme sind keine Randerscheinungen, sondern strukturelle Risiken überall dort, wo Trainingsdaten gesellschaftliche Ungleichheiten widerspiegeln. Aktuelle Forschungsergebnisse zeigen, dass dieser Effekt in Gesichtserkennung, Kreditvergabe und Strafverfolgung besonders gravierend auftritt.

Ethische Grenzen und regulatorische Antworten

Die Debatte um KI-Ethik ist keine philosophische Spielerei, sondern hat handfeste rechtliche Konsequenzen. Der EU AI Act – seit August 2024 in Kraft – klassifiziert KI-Systeme nach Risikoklassen und verbietet bestimmte Anwendungen explizit: soziale Bewertungssysteme durch staatliche Akteure, Echtzeit-Biometrie im öffentlichen Raum, manipulative Techniken unter der Bewusstseinsschwelle. Für Hochrisiko-Anwendungen in Bereichen wie Bildung, Beschäftigung oder kritische Infrastruktur gelten strenge Transparenz- und Dokumentationspflichten.

Die tieferen philosophischen Fragen – Verantwortung, Autonomie, Würde – lassen sich nicht allein regulatorisch lösen. Die philosophische Auseinandersetzung mit KI zeigt, dass Konzepte wie Verantwortlichkeit und moralische Urheberschaft grundlegend neu gedacht werden müssen, wenn Systeme eigenständig Entscheidungen treffen. Wem gegenüber ist ein autonomes Fahrzeug verantwortlich, wenn es in einem Dilemma handeln muss?

Für Praktiker ergibt sich daraus ein konkreter Handlungsrahmen:

- Bias-Audits vor Produktivstart jedes KI-Systems, das Entscheidungen über Menschen trifft

- Erklärbarkeit als Designprinzip, nicht als nachträglicher Zusatz

- Human-in-the-Loop bei allen Hochrisiko-Entscheidungen verpflichtend einplanen

- Interne KI-Governance-Strukturen mit klarer Verantwortungszuweisung etablieren

Wer diese Dimensionen ignoriert, riskiert nicht nur regulatorische Sanktionen, sondern – wie der Fall von Fehlentwicklungen in KI-Projekten immer wieder zeigt – erhebliche Reputationsschäden und das Scheitern ganzer Transformationsinitiativen. Technologische Exzellenz und ethische Reflexion sind in diesem Bereich keine Gegensätze, sondern Voraussetzungen für nachhaltigen Erfolg.

Wichtige Fragen zu Künstlicher Intelligenz im Jahr 2026

Was ist Künstliche Intelligenz (KI)?

Künstliche Intelligenz (KI) bezeichnet Systeme oder Maschinen, die menschliche Intelligenz simulieren, um Aufgaben auszuführen, die normalerweise menschliches Denken erfordern, wie Lernen, Problemlösen und Entscheidungsfindung.

Wie wird KI in der Industrie eingesetzt?

KI wird in verschiedenen Industrien eingesetzt, um Arbeitsabläufe zu automatisieren, Datenanalysen durchzuführen, personalisierte Kundenerlebnisse zu schaffen und die Effizienz zu steigern, beispielsweise in der Fertigung, Medizin und Logistik.

Was sind die Haupttechnologien hinter KI?

Die Haupttechnologien hinter KI umfassen Machine Learning, Deep Learning, neuronale Netze und natürliche Sprachverarbeitung. Diese Technologien ermöglichen es KI-Systemen, Muster in Daten zu erkennen und Entscheidungen zu treffen.

Welche Herausforderungen gibt es bei der Implementierung von KI?

Herausforderungen bei der Implementierung von KI umfassen ethische Bedenken über Datenschutz und Bias, technische Schwierigkeiten wie Datenqualität und -zugänglichkeit sowie die Notwendigkeit, Mitarbeiter im Umgang mit der Technologie zu schulen.

Wie beeinflusst KI die Arbeitsplatzlandschaft?

KI verändert die Arbeitsplatzlandschaft, indem sie repetitive Aufgaben automatisiert und neue Berufsfelder schafft, die Fähigkeiten in Datenanalyse und KI-Management erfordern. Dadurch kann es sowohl zu Jobverlusten in traditionellen Bereichen als auch zu neuen Chancen in innovativen Sektoren kommen.